很多年来,电影人一直在努力捕捉人类运动的精髓——作为观众,我们天生就有能力识别出那些不完全真实的运动,于是让这个工作变得更具挑战性。想实现这一目标,需要精心设计、耗资巨大的布景,但结果仍常常出现“恐怖谷效应”。

影片《极地特快》(The Polar Express)2004 剧照

导演:罗伯特·泽米吉斯(Robert Zemeckis) 动画 2004.11月美国上映

罗伯特·泽米吉斯(Robert Zemeckis)利用动作捕捉技术,在21世纪初执导了几部具有开创性的动画电影,其中包括《极地特快》和《贝奥武夫》。这些作品取得了新的突破,代表了当时动作捕捉技术的顶峰,但仍然有一定的局限性,角色有时看上去缺乏生气,动作也缺乏真实感。

影片《贝奥武夫》(Beowulf)2005 剧照

导演:罗伯特·泽米吉斯(Robert Zemeckis) 2007.11月美国上映

影片《贝奥武夫》(Beowulf)片段

詹姆斯·卡梅隆(James Cameron)的《阿凡达》系列电影进一步挑战了动作捕捉技术的极限。他不仅大大提高了动作捕捉系统的保真度,还在动作捕捉摄影棚中加入人类掌机,使最终呈现的画面效果更加逼真。拍摄过程中巨大的技术挑战意味着这部电影是有史以来成本最高的电影之一,其后期制作也长达数年之久。

影片:《阿凡达:水之道》(Avatar: The Way of Water)2022 花絮:动作捕捉

导演: 詹姆斯·卡梅隆 (James Cameron) 2022.12 美国

如今,人工智能和机器视觉的进步——后者指的是能让计算机分析视频片段的AI——通过简化流程,为动作捕捉技术开辟了新天地。目前有关画面制作的AI讨论主要倾向于生成式AI,而用于动作捕捉的AI则完全不同,它依靠机器学习系统来解决复杂的数学问题,从而推断出身体结构运动——而不是直接生成画面。

最新的AI工具拓展了动作捕捉的可能性,重要的是,当这些不断发展的技术将捕捉过程从受限的摄影棚释放到传统片场上时,电影摄影师及其工作人员必须随时了解相关信息。

传统动作捕捉技术面临的挑战

传统用于摄影棚制作的动作捕捉技术通常需要大量经过校准的红外摄影机来捕捉附着在表演者和物体上的标记点,还需要一个系统通过比较摄影机的视角来确定标记点在空间中的位置。

传统的动作捕捉技术所提供的数据高度精确,被认为是剧情片视效和AAA级视频游戏的“金本位”——尤其是在创建与真人电影摄影完美融合的数字运动方面。这些系统所面临的挑战包括需要一个专门用于捕捉的空间,以及对表演者和要捕捉的其他对象进行标记。它还禁止同时捕捉动态影像,除非在后期制作中可进行大量转描并移除标记点和跟踪设备。

另外,此类系统——以及采用传感器套件的系统——可能需要进行大量的后期处理,因此不太适合实时应用。另一个顾虑是,这些过程可能会给表演者,尤其是儿童和动物带来不便。

AI动作捕捉的定义

AI动作捕捉利用人工智能和机器视觉的结合来跟踪视频素材中人或其他对象的运动。它首先从摄影机或传感器收集数据,然后利用机器学习模型和神经网络来检测和跟踪捕捉对象姿势的关键点,并输出得到的运动数据,以便应用到虚拟角色中。

这里的关键在于,CG角色或捕捉对象的精确逼真运动可以通过保真度相对较低的原始数据来实现,这些数据通常来自标准的视频捕捉——AI可以填补数据中的“空白”,允许采用低准确率的收集方法。

不同于传统的动作捕捉,AI动作捕捉通常不需要标记点或特殊服装,因此对拍摄对象来说更方便,对特定捕捉环境的依赖度也更低——具有高度自动化、可扩展性和适应性。选择AI动作捕捉还是传统动作捕捉,取决于具体的项目要求和预算。

下面,我们将探讨相关的一些工具。

Move.ai

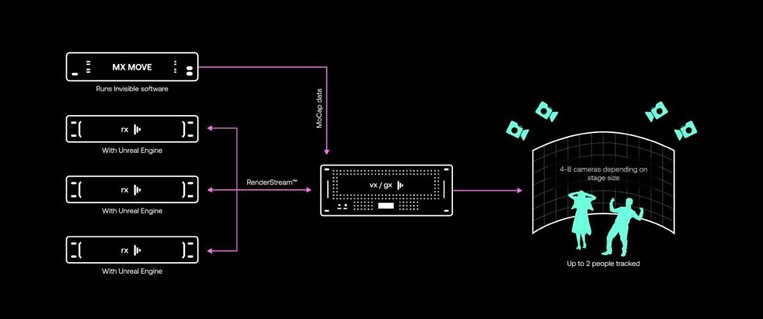

Move.ai是一个快速发展的AI动作捕捉产品,一个可扩展的系统,可以将视频从消费级摄影机拍摄的画面效果处理成与Invisible兼容的无标记动作捕捉,是一个整合了Disguise MX Move硬件的实时综合工具。该系统的手机应用版使用来自苹果手机的视频片段,而企业版则可以收集多种现成摄影机的数据。“

使用Move.ai通过视频画面实时操控木偶角色。Move.ai将视频 处理为与Invisible兼容,

并由Disguise MX Move硬件提供支持

Move.ai基于卷积神经网络,”该公司合作人之一、副总裁尼尔·亨德里(Niall Hendry)说,“通常情况下,公司会从谷歌和meta的现成数据模型入手,但要获得一个好的数据库,最终还是需要建立自己的模型。

基于AI动作捕捉数据的Move. ai渲染

我们拍摄了大量的运动视频,并对其进行标记——从霹雳舞者到空转动作——从而定义特定关节(如肘部)在画面中的运动。添加的视频越多,识别的特征和异常情况越多,模型就能越好、更准确地学习从新视频中获取运动数据。

Move.ai的数据流图,用于多摄影机模式

”Disguise虚拟制作副总裁阿迪·加尼(Addy Ghani)补充道:“人体骨骼的行为遵循一套规则,这些规则可以转化为一个被称之为‘逆运动学’的数学模型。例如,当我向后掰我的手指时,只能掰这么远,它的运动范围是有限的。同样,当AI模型从视频中生成运动数据时,也不会超过真实骨骼的性能。它还可以模仿更高阶的骨骼行为。例如,如果你抬起手,你的肘部就会跟着抬起,肩膀也会向上转动。这让Move.ai从数学的角度认识到了人体形态的物理能力和限制。”

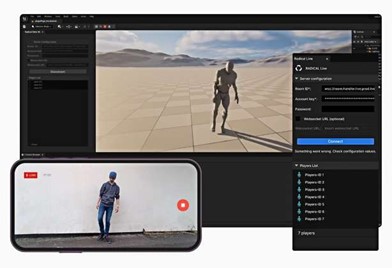

Radical

Radical也是一种从视频片段中提取全身动作的AI动作捕捉产品。该软件还包括含Blender、Maya、Unity和Unreal Engine等3D软件的插件,可将实时运动数据直接传输到3D角色中。

Radical包含了Blender、Maya、Unity和Unreal Engine等 3D 软件的插件

Radical以订阅模式为基础,旨在为新兴内容创作者和高端剧情片及视频游戏制作提供可扩展的产品。该系统通过云服务获得处理能力,无需专门的本地处理设备即可运行。

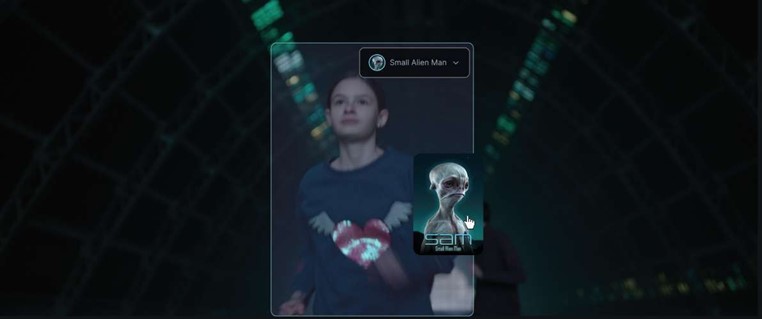

Wonder Studio

由开放商Wonder Dynamics推出Wonder Studio更进一步,将AI衍生的动作捕捉与端到端的视效创作平台相结合。Wonder能在真人场景中自动制作动画、布光与合成CG角色——并可以从实景素材中将原始表演者转描出来。

Wonder Studio AI动作捕捉系统使用视频片段作为原始数据,让电影人可以用CG角色

代替真人表演。

虽然Wonder处理真人素材的时间比其他AI动作捕捉产品要长得多,但它能做的远不只提取动作。与传统视效相比,Wonder生成结果的技术精度和逼真度较低,但它只需要很少的时间和预算就能完成。根据项目的范围和需求,WonderStudio的结果——在一小时内可以完成从真人素材到合成动画角色——可以满足预览、临时画面甚至最终版本的需要。

索尼Mocopi

索尼的Mocopi【取自“动作复制”(motioncopy)一词】采用不同的方法来应对同样的挑战,它是一种基于无线、佩戴及手机式的传感器系统,用于控制虚拟化身——因此的确包含了可佩戴元素。

索尼Mocopi AI动作捕捉技术利用身体传感器来控制CG角色的动作

“Mocopi是我们首创的、旨在为内容创作者提供一个经济实用、轻巧便携的全身追踪系统,以简化其虚拟制作工作流程。”索尼XR业务开发主管泰萨·亚马穆拉(Thaisa Yamamura)说道。

“Mocopi利用索尼专门的机器学习算法,通过六个无线身体追踪器提供精确的运动追踪数据,其中包括方向追踪加速度计和角速率传感器,并通过蓝牙连接到我们的移动应用程序上,”亚马穆拉继续说,“这个系统的架设非常简单,我们还提供了Unity和Unreal的开发工具包,使创作者能够将其综合运用到自定义项目中。

”Mocopi主要面向YouTube和TikTok上的内容创作者,比起跟更复杂系统的保真性,它更注重好用性。Mocopi的效果通常能达到预览和临时视效场景的基本质量。

最后总结

这些AI动作捕捉产品各有所长。总的来说,这个新技术具有一定潜力,可以帮助电影人在专业设备和拍摄环境有限的条件下——快速地将原始动作捕捉数据转化为从低保真/预览到人眼完全可信的画面。

(全文完)

本期内容为《美国电影摄影师(ASC)杂志》2023-12月刊文《虚拟世界:动作捕捉中的AI》;本文作者:诺亚·卡德纳;